Ollama là một công cụ mã nguồn mở, hoàn toàn miễn phí, được thiết kế để đơn giản hóa quá trình vận hành các mô hình ngôn ngữ lớn (LLM) trực tiếp trên thiết bị cá nhân. Công cụ này cung cấp một giao diện lập trình ứng dụng (API) dễ sử dụng cùng với một kho các mô hình được xây dựng sẵn, phục vụ cho cả các nhà phát triển và những người có hứng thú với AI .

Với khả năng hoạt động không cần kết nối mạng và bảo vệ dữ liệu, Ollama đang dần khẳng định vị thế là một trong những lựa chọn hàng đầu để triển khai LLM tại chỗ, loại bỏ sự phụ thuộc vào các dịch vụ đám mây.

Ollama là một công cụ mã nguồn mở hỗ trợ chạy chương trình , được xây dựng chủ yếu bằng ngôn ngữ lập trình Golang (chiếm 89% mã nguồn). Mục đích chính của nó là để chạy các mô hình ngôn ngữ mở ngay trên máy tính cá nhân hoặc máy chủ.

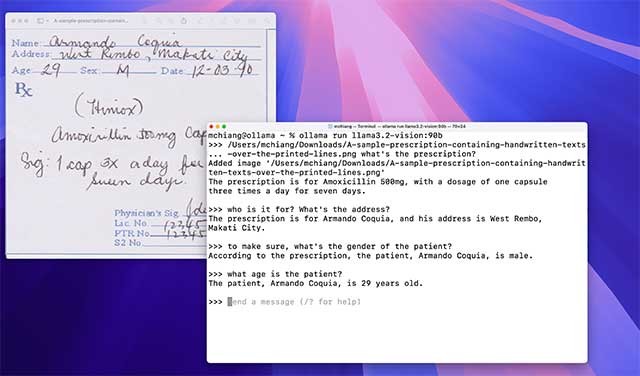

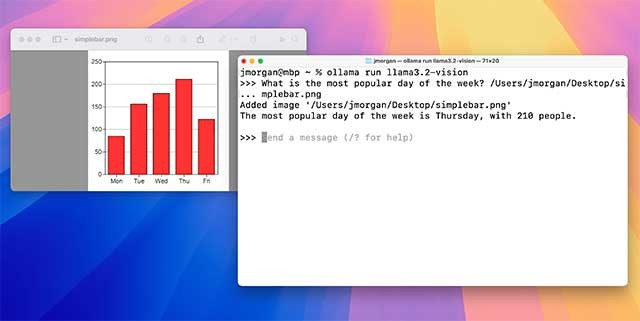

Phần mềm này không chỉ thực thi các mô hình mà còn cung cấp một lớp API, cho phép tích hợp chúng vào các ứng dụng và dịch vụ khác một cách dễ dàng.

Ưu điểm nổi bật của Ollama là sự đơn giản và tính thân thiện với người dùng. Công cụ này đóng gói các mô hình trong các file riêng biệt (.modelfile), giúp việc cài đặt, quản lý và tùy chỉnh trở nên dễ dàng hơn bao giờ hết.

Người dùng có thể tải xuống, quản lý và chạy nhiều loại LLM khác nhau như Llama 3.2, Mistral, Code Llama, LLaVA, Phi-3,… mà không cần phải thực hiện các cấu hình phức tạp.

So với các dịch vụ AI dựa trên nền tảng đám mây, Ollama có khả năng hoạt động hoàn toàn độc lập, không cần kết nối internet. Điều này đảm bảo rằng dữ liệu của bạn luôn được bảo mật và lưu trữ trên thiết bị của bạn, tránh được nguy cơ bị thu thập hoặc sử dụng cho mục đích đào tạo mô hình của các bên thứ ba.

Ollama mang đến khả năng vận hành các mô hình ngôn ngữ lớn (LLM) trực tiếp trên thiết bị, không yêu cầu kết nối internet. Điều này đảm bảo tính bảo mật tối đa cho dữ liệu cá nhân và thông tin doanh nghiệp, khác biệt so với các giải pháp dựa trên nền tảng đám mây.

Việc tải xuống và triển khai các mô hình LLM trở nên dễ dàng hơn bao giờ hết với chỉ một lệnh duy nhất (ollama pull). Thư viện mô hình của Ollama hiện hỗ trợ hơn 150 lựa chọn, bao gồm DeepSeek R1, Smollm, Gemma 2, Phi 4 và Codestral.

Ollama được thiết kế để dễ dàng cài đặt trên các hệ điều hành Windows, Linux và macOS. Chỉ cần một lệnh đơn giản, giao diện dòng lệnh (CLI) của Ollama sẽ được kích hoạt trên máy tính của bạn mà không cần trải qua các bước cấu hình phức tạp.

Bằng cách sử dụng một lệnh cụ thể, người dùng có thể triển khai API để tích hợp LLM vào các ứng dụng khác. Điều này cho phép gửi các yêu cầu (prompt) và nhận các phản hồi có cấu trúc, phục vụ cho nhiều mục đích ứng dụng AI khác nhau.

Với Ollama, người dùng có thể điều chỉnh các thông số của mô hình để khai thác tối đa hiệu suất của LLM trên máy tính cá nhân. Việc thay đổi cấu hình, tinh chỉnh các tham số và điều chỉnh hành vi của mô hình giúp đáp ứng tốt hơn các nhu cầu cụ thể.

Hệ thống của Ollama tự động phát hiện và sử dụng GPU hoặc CPU để tối ưu hóa hiệu suất, cho phép chạy các LLM có dung lượng lớn ngay trên máy tính cá nhân.

Ngoài giao diện dòng lệnh (CLI), Ollama còn cung cấp giao diện web (Web UI) mã nguồn mở với giao diện trò chuyện trực quan. Giao diện này hoạt động hoàn toàn ngoại tuyến và dễ sử dụng, phù hợp với cả người mới bắt đầu.

Tóm lại, Ollama là một giải pháp lý tưởng cho các nhà phát triển, lập trình viên và các tổ chức mong muốn chạy LLM một cách an toàn, bảo mật và linh hoạt trên máy tính cá nhân. Sự kết hợp giữa quá trình cài đặt đơn giản, kho mô hình đa dạng và khả năng hoạt động ngoại tuyến khiến Ollama trở thành một công cụ đáng tin cậy trong xu hướng AI on-device hiện nay.

1 nhận xét